服务热线

站点介绍

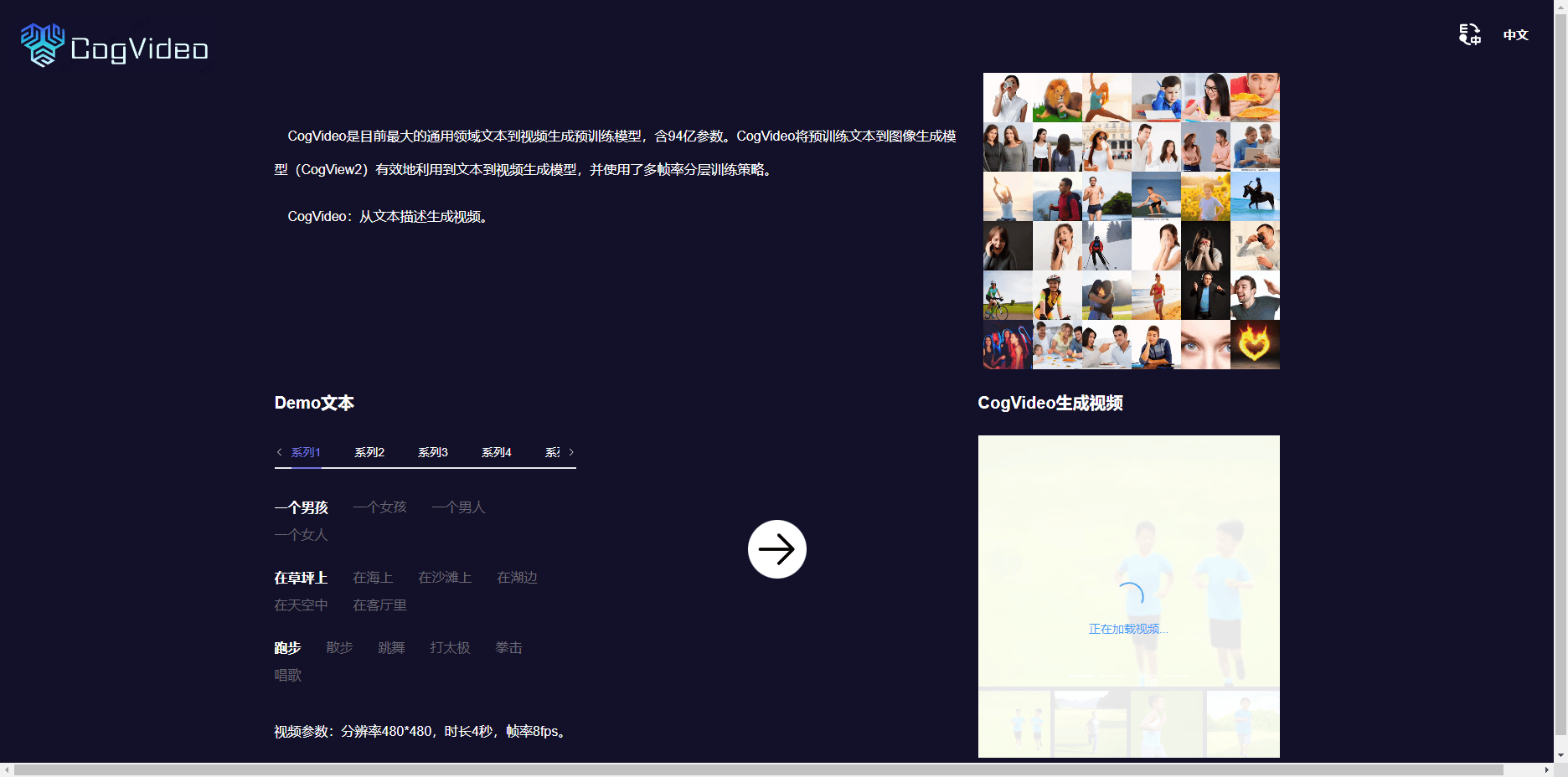

CogVideo是目前最大的通用领域文本到视频生成预训练模型,含94亿参数。CogVideo将预训练文本到图像生成模型(CogView2)有效地利用到文本到视频生成模型,并使用了多帧率分层训练策略。用于文本到视频的生成。它是基于Transformer架构的,旨在通过理解和转换文本描述来生成相应的视频内容。CogVideo能够处理大量的文本-视频对数据,并通过学习这些数据的模式来生成与文本描述相匹配的视频。

具体来说,CogVideo的设计基于预训练的文本-图像模型CogView2,它分为两个主要模块。首先,第一个模块使用CogView2来根据文本描述生成几帧图像。然而,在这个阶段生成的视频的帧率还相对较低。接下来,第二个模块利用双向注意力模型对这些生成的图像进行插帧,以增加视频的帧率并生成更完整的视频。

在训练过程中,CogVideo使用了大量的文本-视频对数据。这些数据不仅仅是简单的文本和视频匹配,而是需要将视频拆分成多个帧,并为每个帧添加帧标记,以便模型能够更准确地理解文本与视频内容之间的对应关系。

CogVideo还采用了一种多帧率分层训练策略,以更好地对齐文本和视频剪辑。这种策略有助于模型更好地理解文本描述与视频内容之间的关系,并生成更精确、更符合文本描述的视频。

CogVideo的功能特点

CogVideo的功能特点CogVideo开源代码库:https://github.com/THUDM/CogVideo

请注意,目前CogVideo只支持简体中文输入。

如果你经常无法打开"CogVideo",可能有以下三种原因。这里有一些解决方案:

如还有疑问,可在线留言,着急的话也可以通微信联系管理员。

1、本站所提供的 "CogVideo" 站点内容均来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由本站实际控制。

2、在2024-09-03 12:13:09收录时,该站点的内容都属于合规合法,后期该站点如出现违规,可以直接联系管理员进行删除,本站不承担任何责任。